| 失效链接处理 |

|

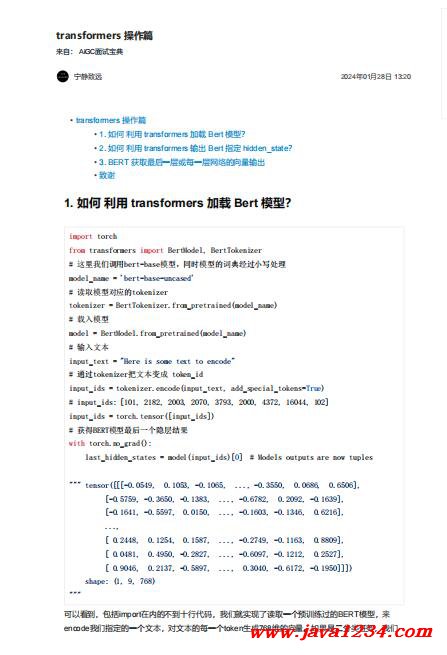

transformers 操作篇 PDF 下载

相关截图:

主要内容: 1. 如何 利用 transformers 加载 Bert 模型?

2. 如何 利用 transformers 输出 Bert 指定 hidden_state?

Bert 默认是 十二层,但是有时候预训练时并不需要利用全部利用,而只需要预训练前面几层即

可,此时该怎么做呢?

下载到bert-base-uncased的模型目录里面包含 配置文件 config.json, 该文件中包含

output_hidden_states,可以利用该参数来设置 编码器内隐藏层层数

|

苏公网安备 32061202001004号

苏公网安备 32061202001004号