| 失效链接处理 |

|

机器学习基于决策树算法实现与项目应用:分类与回归任务中的模型构建、剪枝优化及实战代码解析 PDF 下载

转载自:

相关截图:

主要内容:

一、决策树算法理论基础

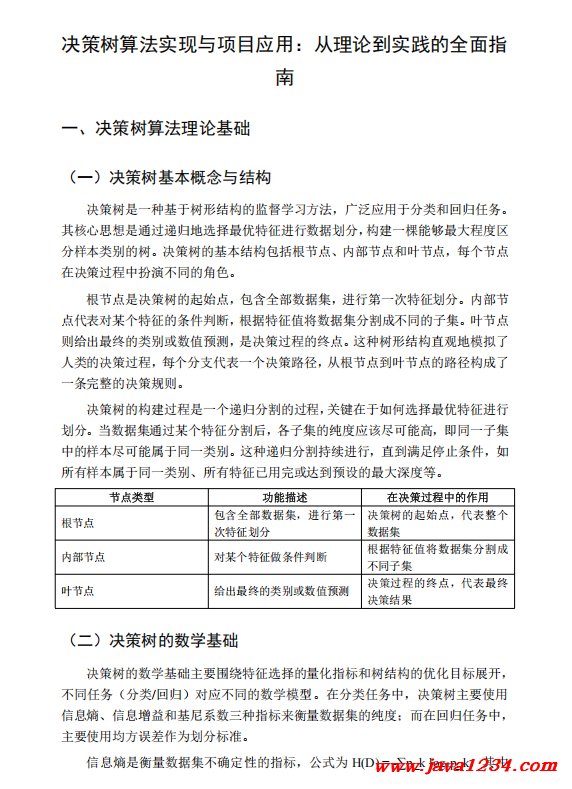

(一)决策树基本概念与结构

决策树是一种基于树形结构的监督学习方法,广泛应用于分类和回归任务。

其核心思想是通过递归地选择最优特征进行数据划分,构建一棵能够最大程度区

分样本类别的树。决策树的基本结构包括根节点、内部节点和叶节点,每个节点

在决策过程中扮演不同的角色。

根节点是决策树的起始点,包含全部数据集,进行第一次特征划分。内部节

点代表对某个特征的条件判断,根据特征值将数据集分割成不同的子集。叶节点

则给出最终的类别或数值预测,是决策过程的终点。这种树形结构直观地模拟了

人类的决策过程,每个分支代表一个决策路径,从根节点到叶节点的路径构成了

一条完整的决策规则。

决策树的构建过程是一个递归分割的过程,关键在于如何选择最优特征进行

划分。当数据集通过某个特征分割后,各子集的纯度应该尽可能高,即同一子集

中的样本尽可能属于同一类别。这种递归分割持续进行,直到满足停止条件,如

所有样本属于同一类别、所有特征已用完或达到预设的最大深度等。

(二)决策树的数学基础

决策树的数学基础主要围绕特征选择的量化指标和树结构的优化目标展开,

不同任务(分类/回归)对应不同的数学模型。在分类任务中,决策树主要使用

信息熵、信息增益和基尼系数三种指标来衡量数据集的纯度;而在回归任务中,

主要使用均方误差作为划分标准。

信息熵是衡量数据集不确定性的指标,公式为H(D)=-∑p_k log₂p_k,其中

p_k 是第k 类样本在数据集中的比例。熵值越小,数据集越纯净。当所有样本属

于同一类别时,熵为0;当类别分布均匀时,熵达到最大值。信息熵的概念源自

信息论,反映了数据集的不确定性程度,是决策树算法的重要理论基础。

信息增益衡量使用某特征划分后信息不确定性减少的程度,是ID3 算法的核

心。其中D_v 是特征A 取值为v 的子集。信息增益越大,说明该特征对分类的贡献越大。

然而,信息增益存在偏向

多取值特征的缺陷,这促使了信息增益率的提出。

基尼系数是CART 分类树的核心指标,衡量数据集的不纯度,公式为Gini(D)

=1 -∑p_k²,表示随机抽取两个样本类别不一致的概率。基尼系数越小,数据集

越纯净。与信息熵相比,基尼系数不需要计算对数,计算效率更高,因此在实际

应用中更为广泛。

在回归任务中,决策树主要使用均方误差(MSE)作为划分标准,公式为

MSE(D)=,其中ȳ是数据集D 中样本输出的均值。回归树选择使

划分后加权MSE 最小的特征进行划分,这与分类树中的纯度提升目标类似,但

优化的是数值预测的准确性。

|

苏公网安备 32061202001004号

苏公网安备 32061202001004号